Nel corso dell’ultimo anno vi abbiamo parlato molto dell’intelligenza artificiale, delle sue opportunità e, ovviamente, dei suoi rischi. Oggi vogliamo invece concentrarci sulle responsabilità dei CISO in ottica intelligenza artificiale, dei vantaggi di una gestione ottimale della tecnologia e dell’importanza di mitigare i rischi che ben conosciamo.

Per farlo abbiamo chiesto il parere di Gail Coury, Vicepresidente e CISO di F5S, che ci ha illustrato il suo punto di vista sulla situazione:

“Seguendo alcune importanti best practice saremo meglio preparati ad accogliere in tutta tranquillità i nostri nuovi Mr. Robot in azienda”, ci dice. Del resto la spinta anche in ambito consumer di ChatGPT sta portando molte aziende ad implementare la tecnologia.

Intelligenza artificiale al servizio dei CISO: opportunità di crescita

Per prima cosa Coury ci elenca una serie di opportunità per le aziende. Vediamone alcune:

- Creazione di contenuti: l’AI generativa può aiutare i redattori di contenuti a formulare schemi e bozze, consentendo loro di risparmiare tempo e lavoro. Ad esempio, ChatGPT è in grado di scrivere testi coerenti e persuasivi su qualsiasi argomento, a partire da una parola chiave o da una frase iniziale.

- Apprendimento e formazione: l’AI generativa può essere utilizzata per comprendere in modo rapido argomenti nuovi e complessi, sintetizzando grandi quantità di informazioni, rispondendo a domande e spiegando concetti complicati con un linguaggio semplice. Ad esempio, OpenAI API Service offre un accesso facile e veloce a diversi modelli di intelligenza artificiale che possono svolgere varie funzioni, come la traduzione, la sommarizzazione, la classificazione o la generazione di testi.

- Supporto al coding: l’AI generativa può aiutare gli sviluppatori a scrivere un codice in modo più efficiente e a identificare gli errori nelle query. Ad esempio, GitHub Copilot è uno strumento che suggerisce linee di codice in base al contesto e alla logica del programma, aiutando gli sviluppatori a completare i loro progetti più velocemente e con meno errori.

- Supporto al prodotto e alle operations: l’AI generativa può essere utilizzata per preparare in maniera ottimale i report e gli annunci più frequenti, come ad esempio la risoluzione dei bug. Ad esempio, ChatGPT può generare messaggi personalizzati e pertinenti per i clienti o i dipendenti, migliorando la comunicazione e la soddisfazione.

“In qualità di CISO aiutiamo i nostri manager a creare una strategia organizzativa che fornisca linee guida per l’utilizzo dell’AI e tenga conto degli aspetti legali, etici e operativi”, spiega Gail Coury. “Se impiegata in modo responsabile e con un’adeguata struttura di governance, l’AI generativa può offrire alle aziende vantaggi che vanno dai processi automatizzati a soluzioni ottimizzate”

Scopri Bitdefender per la protezione dei tuoi dati, Leader mondiale nella sicurezza informatica!

I rischi e le sfide

Nonostante i numerosi benefici che l’AI generativa può portare al business, ci sono anche dei rischi e delle sfide da affrontare, sia dal punto di vista legale che dal punto di vista della sicurezza.

- Aspetti legali: l’utilizzo dell’AI generativa deve essere in linea con le leggi e i regolamenti vigenti a livello internazionale, che possono variare da paese a paese. Ad esempio, all’inizio di quest’anno, OpenAI ha temporaneamente bloccato l’uso di ChatGPT in Italia dopo che l’autorità italiana per la protezione dei dati ha accusato l’azienda di raccogliere illegalmente i dati degli utenti. Nel frattempo, le autorità di regolamentazione tedesche stanno verificando se ChatGPT aderisce al regolamento generale sulla protezione dei dati (GDPR). A maggio, il Parlamento europeo ha fatto un passo avanti verso l’emanazione delle prime norme sull’uso dell’intelligenza artificiale.

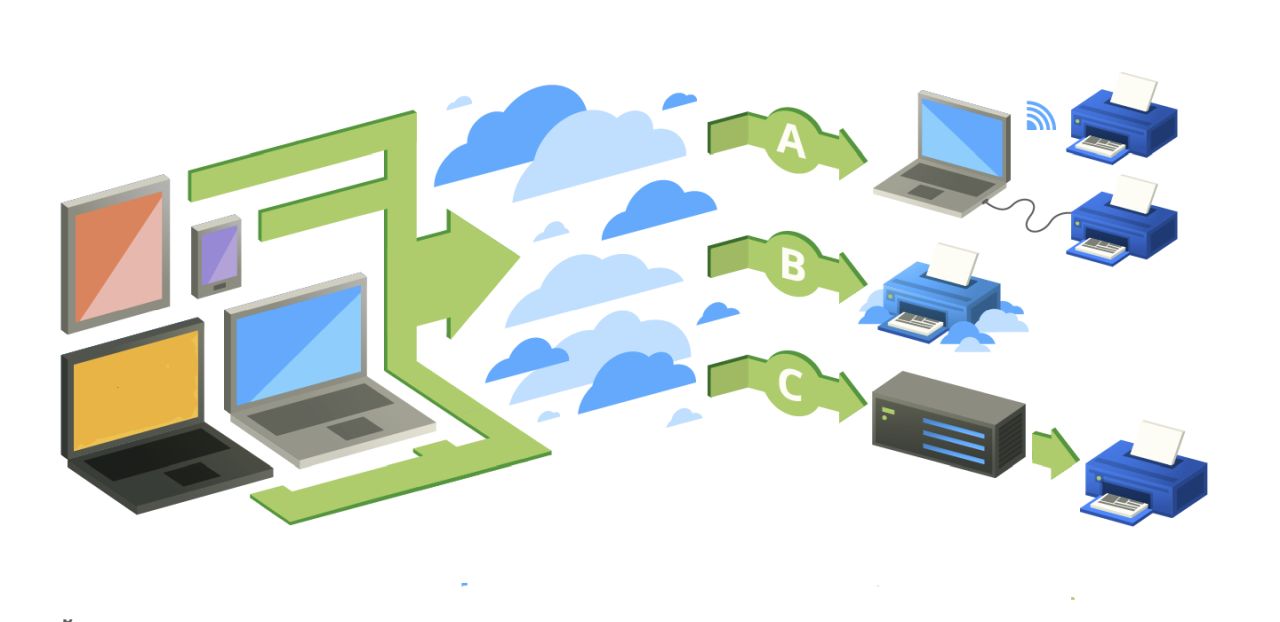

- Protezione dei dati: l’utilizzo dell’AI generativa richiede una grande quantità di dati, che devono essere protetti da possibili furti, perdite o divulgazioni accidentali. Le aziende devono assicurarsi di non condividere informazioni personali o proprietarie con altri utenti o aziende che utilizzano i loro stessi strumenti. Abbiamo già avuto notizia dell’inserimento di proprietà intellettuale in sistemi di AI generativi pubblici, il che potrebbe avere un impatto sulla capacità di un’azienda di difendere i propri brevetti. Un servizio di trascrizione e registrazione di appunti alimentato dall’intelligenza artificiale riproduce qualsiasi materiale condiviso nelle chiamate Zoom che monitora.

- Cyberattacchi: l’utilizzo dell’AI generativa può essere sfruttato da hacker e criminali informatici per condurre attacchi più sofisticati e difficili da rilevare e contrastare. Ad esempio, abbiamo assistito a nuovi e sofisticati episodi di phishing che utilizzano l’intelligenza artificiale. Tra questi casi in cui l’AI è stata usata per impersonare individui sia per iscritto che a voce. Altro esempi è PassGAN, acronimo di Password Generative Adversarial Network, un software AI in grado di decifrare le password.

Intelligenza artificiale: le best practice per i CISO

Per affrontare i rischi e le sfide dell’AI generativa, i CISO devono essere preparati e aggiornati sulle ultime novità e tendenze in questo campo. Inoltre, devono seguire alcune importanti best practice, tra cui:

- Valutare i rischi: i CISO sono chiamati a valutare i rischi associati all’utilizzo dell’AI generativa in base al tipo di contenuto. Devono anche considerare gli aspetti etici, legali e sociali dell’AI generativa, come ad esempio il rispetto della privacy, della proprietà intellettuale e dei diritti umani.

- Adottare misure di sicurezza: i CISO devono adottare misure di sicurezza adeguate per proteggere i dati e i contenuti generati dall’AI generativa. Queste misure possono includere la cifratura, l’autenticazione, l’autorizzazione, il monitoraggio, il backup e il ripristino dei dati. Inoltre, i CISO devono essere in grado di riconoscere e contrastare gli attacchi basati sull’AI generativa, come ad esempio il phishing o la falsificazione.

- Educare e formare: vale a dire educare e formare i dipendenti e i clienti sull’uso responsabile e sicuro dell’AI generativa. I CISO devono anche sensibilizzare sulle potenzialità e sui limiti dell’intelligenza artificiale, evitando sia l’eccessiva fiducia che la diffidenza nei confronti di questa tecnologia.

“Una volta che la vostra organizzazione avrà valutato e dato priorità ai casi di utilizzo dell’AI generativa, è necessario stabilire una governance per i servizi di AI come ChatGPT le cui componenti comprenderanno la definizione di regole per la raccolta e la conservazione dei dati e la creazione di policy per mitigare il rischio di bias, anticipare i modi in cui i sistemi possono essere abusati e mitigare i danni che potrebbero causare, se usati in modo improprio”

Rimani aggiornato seguendoci su Google News!

Da non perdere questa settimana su Techbusiness

🍎Indeed: che impatto avrà l’Intelligenza Artificiale sul futuro del lavoro?

☄️Data breach: le 8 cause principali della fuga di informazioni

🖥️Lavoro ibrido: i numeri del fenomeno e le soluzioni integrate di Logitech e Microsoft

🖨️FUJIFILM annuncia la serie Apeos, l'innovativa linea di stampanti multifunzione

✒️ La nostra imperdibile newsletter Caffellattech! Iscriviti qui

🎧 Ma lo sai che anche Fjona ha la sua newsletter?! Iscriviti a SuggeriPODCAST!

📺 Trovi Fjona anche su RAI Play con Touch - Impronta digitale!

💌 Risolviamo i tuoi problemi di cuore con B1NARY

🎧 Ascolta il nostro imperdibile podcast Le vie del Tech

💸E trovi un po' di offerte interessanti su Telegram!