Come ben sappiamo, l’Intelligenza Artificiale (AI) sta rivoluzionando il mondo del business, offrendo alle aziende nuove opportunità di ottimizzare le loro attività e raggiungere i loro obiettivi. Tuttavia, l’adozione di tecnologie basate su intelligenza artificiale comporta anche dei rischi, soprattutto se si tratta di strumenti basati su piattaforme o librerie open source, che potrebbero essere vulnerabili agli attacchi informatici. Come possono le aziende proteggersi da queste minacce e garantire la sicurezza dei loro dati e dei loro processi?

Per avere un quadro chiaro della situazione, abbiamo posto le nostre domande a Loredana Ferraiuolo, country manager di Commvault Italia. Per prima cosa, Ferraiuolo ci ha citato un recente studio del Politecnico di Milano, salvo poi approfondire la tematica della sicurezza informatica relativa all’AI. Ma procediamo con ordine.

Quali sono i rischi legati all’intelligenza artificiale?

Secondo l’Osservatorio Artificial Intelligence 2023 della School of Management del Politecnico di Milano, il mercato dell’AI in Italia ha raggiunto 500 milioni di euro nel 2022, con una crescita del 32% in un solo anno. Il 61% delle grandi imprese italiane ha già avviato almeno un progetto di AI, mentre le PMI raggiungono invece il 15%. Questi dati mostrano come l’AI sia sempre più diffusa e richiesta nel panorama nazionale, ma anche come sia necessario affrontare il tema della sicurezza con attenzione e responsabilità.

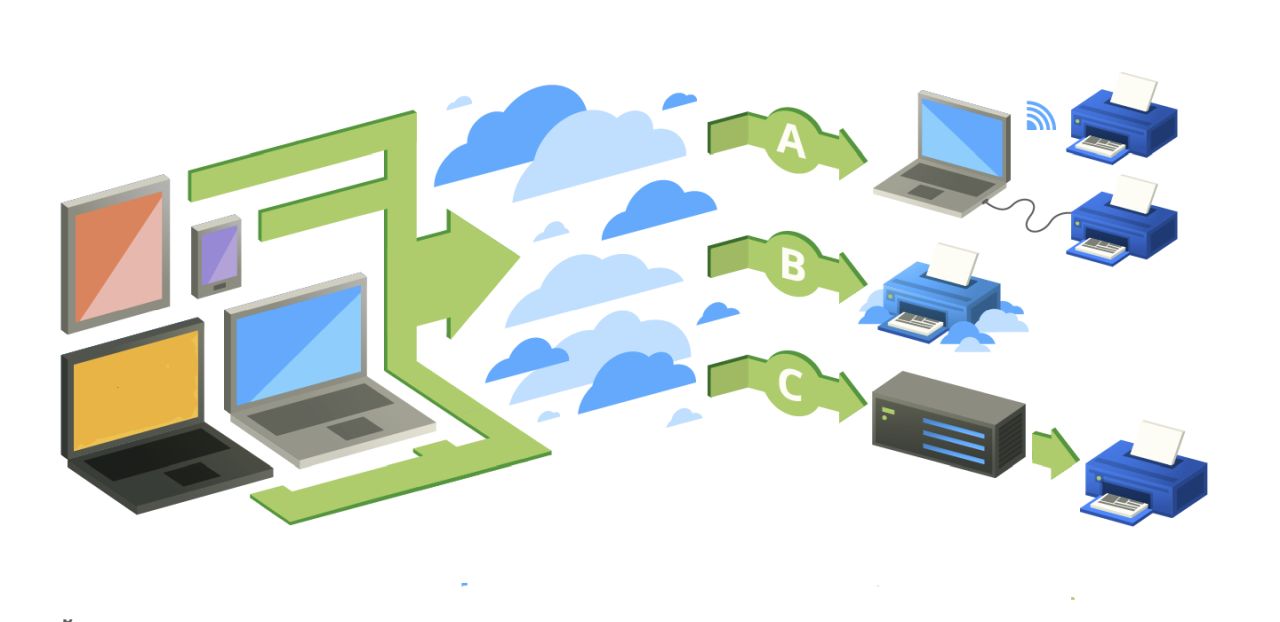

Infatti, molti dei prodotti e dei servizi basati sull’AI fanno affidamento su infrastrutture open source, ovvero piattaforme o librerie di codice che sono accessibili e modificabili da chiunque. Questo aspetto ha dei vantaggi, come la facilità di utilizzo, la condivisione della conoscenza e la collaborazione tra gli sviluppatori, ma anche dei rischi, come la possibilità che i cybercriminali possano sfruttare delle vulnerabilità o inserire del codice malevolo nelle catene di fornitura IT.

Un esempio di questo tipo di attacco è quello che ha colpito SolarWinds nel 2020, quando degli hacker hanno compromesso migliaia di reti di dati sfruttando una piattaforma open source. Questo caso ha evidenziato come le violazioni della supply chain IT possano causare danni enormi e irreparabili alle aziende e alle istituzioni.

Proteggi i tuoi dati con Bitdefender, Leader mondiale in sicurezza informatica

Come proteggersi?

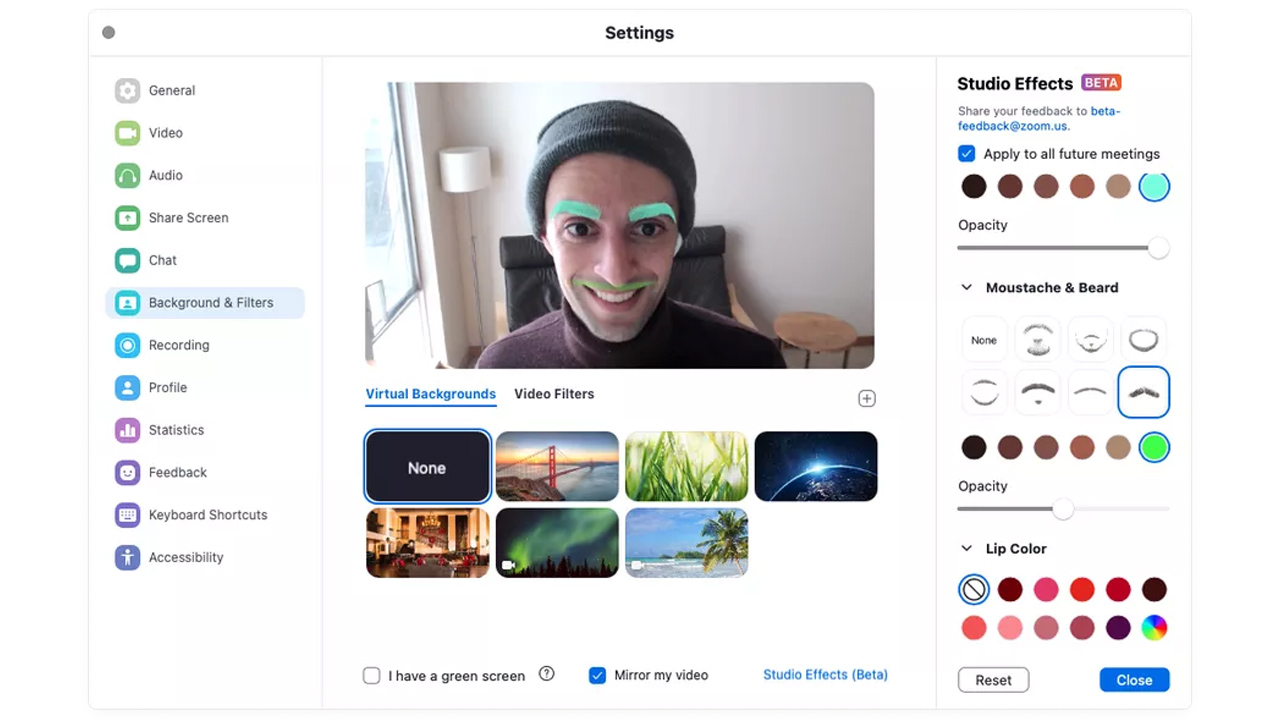

Per evitare che questo scenario si ripeta, è fondamentale che le aziende adottino delle misure preventive e reattive per controllare e monitorare gli strumenti open source che utilizzano o che i loro dipendenti scaricano autonomamente. Questo fenomeno, noto come “shadow IT”, consiste nell’utilizzo di software o dispositivi non autorizzati dal datore di lavoro, ed è stato per anni una fonte di preoccupazione per i CISO e i CIO. Con l’AI, il problema potrebbe aggravarsi, in quanto gli strumenti open source sono sempre più numerosi e sofisticati.

Per contrastare il shadow IT e garantire la sicurezza degli strumenti open source, le aziende dovrebbero seguire alcune buone pratiche, tra cui:

- Creare delle linee guida di accesso che consentano ai dipendenti di utilizzare solo le app o le librerie approvate dall’azienda o dal team di sicurezza.

- Collaborare tra i diversi reparti dell’azienda, in particolare tra sicurezza e sviluppo, per condividere le informazioni e le best practice sull’utilizzo degli strumenti open source.

Consigli specifici per mitigare i rischi dell’intelligenza artificiale

Un primo passo è quello di valutare il valore aggiunto che il software open source può apportare rispetto al rischio che comporta. Per fare questo, le aziende possono utilizzare delle scorecard dei fornitori, che sono dei documenti che riassumono le caratteristiche, le prestazioni e i protocolli di sicurezza dei diversi servizi IT. Confrontando le scorecard dei fornitori, le aziende possono avere una visione più chiara e oggettiva dei possibili partner e decidere a chi affidarsi. Questa è una pratica comune per i team IT aziendali, ma con l’AI diventa ancora più importante, in quanto il numero di strumenti open source è in costante aumento.

Successivamente è importante monitorare costantemente gli strumenti open source utilizzati dall’azienda o dai dipendenti, alla ricerca di eventuali codici sconosciuti o anomalie nella sicurezza. Questo può essere fatto con l’aiuto dell’AI stessa, che può automatizzare gran parte del controllo quotidiano e permettere agli analisti di sicurezza di concentrarsi sulla protezione degli strumenti AI più avanzati.

“Come sempre quando ci si trova di fronte a un elemento di forte innovazione, è importante prendersi il tempo per valutarne rischi e opportunità”, afferma Loredana Ferraiuolo. “Con il giusto approccio, che tenga in considerazione anche le specificità di ogni organizzazione e mercato, sarà possibile ridurre al minimo i primi senza rinunciare alle seconde“.

Rimani aggiornato seguendoci su Google News!

Da non perdere questa settimana su Techbusiness

📈 SAP NOW 2024 l'intelligenza artificiale per il business conquista Milano💸 Come calcolare il ritorno sugli investimenti nell’Intelligenza Artificiale

👨⚖️ Direttiva NIS2 e cybersecurity nelle PMI italiane obblighi e opportunità

🔫 Metà degli attacchi informatici in Italia prende di mira le supply chain

📰 Ma lo sai che abbiamo un sacco di newsletter?

📺 Trovi Fjona anche su RAI Play con Touch - Impronta digitale!

🎧 Ascolta il nostro imperdibile podcast Le vie del Tech

💸E trovi un po' di offerte interessanti su Telegram!