Con l’avvento dell’intelligenza artificiale, lo scenario della sicurezza digitale si sta trasformando. Schemi di social engineering ormai consolidati da anni vengono riadattati per sfruttare al meglio queste nuove tecnologie e diventare ancora più insidiosi.

La minaccia dei deepfake

Uno dei modi in cui l’intelligenza artificiale viene utilizzata nel campo del social engineering è la creazione di deepfake. Un deepfake è un video manipolato digitalmente o creato da un’intelligenza artificiale che ricrea l’immagine di una persona o falsifica un’identità.

Lo scorso febbraio, un gruppo di cybercriminali hanno sferrato un attacco deepfake a una compagnia di Hong Kong, convincendo, con una videochiamata generata da AI, uno dei dipendenti a effettuare un bonifico di 25 milioni di dollari. Lo schema operativo utilizzato per ingannare la vittima non è una novità, ma spaventa come le nuove tecnologie di AI generativa possano essere utilizzate per compiere attacchi di questa gravità.

Le tecniche di social engineering utilizzate dai criminali informatici si evolvono costantemente, e di solito i criminali sono più veloci nell’adottare le nuove tecnologie a loro vantaggio di quanto lo siano le aziende che si occupano di sicurezza a proteggere le loro vittime.

Il fattore rischio umano

Purtroppo, non è ancora presente una generale consapevolezza della costante evoluzione delle tecniche di social engineering. Il grande pubblico, non essendo aggiornato sull’attualità nell’ambito della sicurezza informatica, crede che questo tipo di attacchi non lo interesserà mai, rendendo spesso inefficace la formazione tradizionale e la sensibilizzazione sui temi della cybersecurity. Perciò, l’utente non crede di poter essere preso di mira e, quando questo accase, è impreparato e cade vittima della manipolazione da parte di un malintenzionato.

Gli esseri umani, a differenza dei sistemi informatici, non possono essere “aggiornati”, e saranno sempre l’anello debole della catena di sicurezza. Un dipendente non opportunamente sensibilizzato sul tema della sicurezza o semplicemente poco attento potrebbe non accorgersi di essere vittima di un attacco di social engineering. Ciononostante, è importante non dare colpa alla vittima, ma farle capire dove ha sbagliato e formarla contro eventuali futuri attacchi.

Combattere gli attacchi deepfake

Nonostante gli schemi utilizzati negli attacchi di social engineering siano sempre gli stessi, le aziende non hanno ancora trovato un modo per gestirli, o quantomeno mitigarli, efficacemente. A tal proposito, offriamo alcune idee per garantire, in futuro, una maggiore protezione da questo tipo di attacchi.

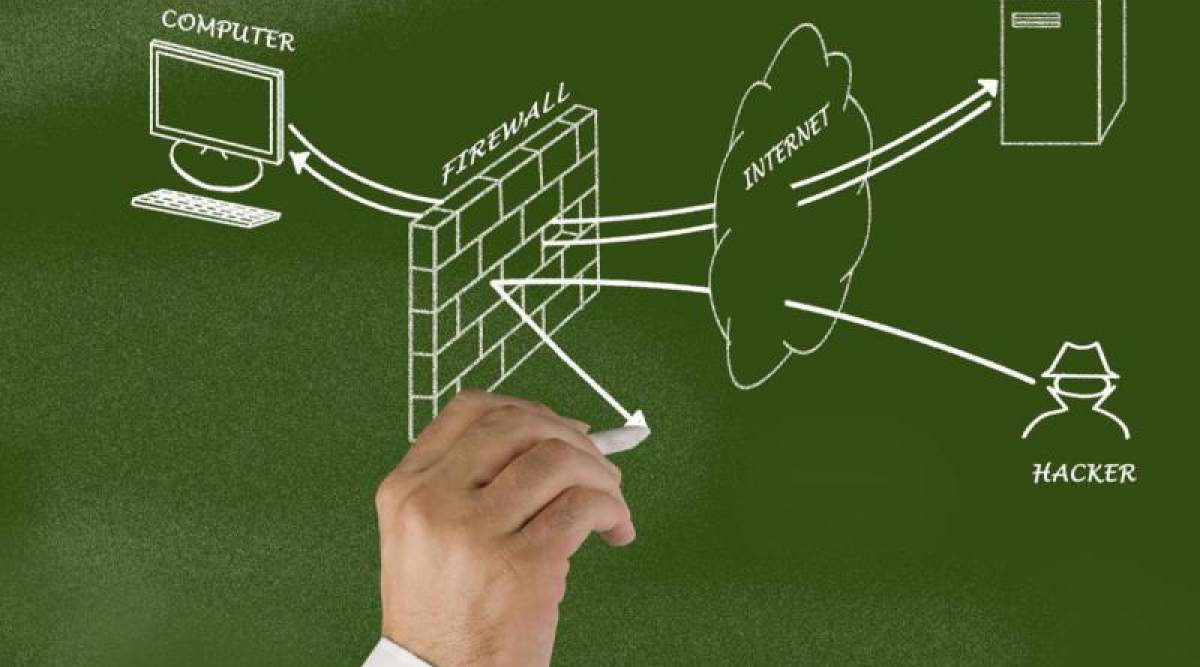

Ricollegandoci all’avvenimento riportato a inizio articolo, si potrebbe fare in modo che i sistemi di videoconferenza includano una funzione per autenticare un utente connesso come umano. Ad esempio, implementare un semplice plug-in che effettui l’autenticazione a due fattori quando un utente tenta di connettersi ad una videochiamata di Zoom o Teams. In questo modo, si eviterebbero accessi da parte di utenti sconosciuti e potenzialmente malevoli.

Di vitale importanza per garantire maggiore sicurezza a 360 gradi è l’adozione di un modello zero trust, orientato all’autenticazione e alla minima concessione dei privilegi. Le soluzioni zero trust non solo possono aiutare a livello di connettività, ma anche migliorare i flussi di lavoro della sicurezza, aiutando a verificare se tutti i partecipanti a una chiamata sono autenticati rispetto a una directory interna. L’adozione di questo modello permette inoltre di rilevare configurazioni di identità errate e prevenire le violazioni di accesso.

Infine, sarebbe necessario un vero e proprio cambiamento culturale: gli individui dovrebbero iniziare a vedere l’AI non come una tecnologia misteriosa e potenzialmente pericolosa, ma come strumento utile e in grado di portare l’umanità in una nuova era di prosperità. L’AI stessa può essere utilizzata per individuare e bloccare attacchi deepfake, tuttavia i responsabili di sicurezza devono imparare a giocare d’anticipo e padroneggiare questo strumento prima che lo facciano i criminali informatici.

- Schick, Nina (Autore)

Rimani aggiornato seguendoci su Google News!

Da non perdere questa settimana su Techbusiness

🔍CrowdStrike e Microsoft al centro del più grande incidente digitale globale

🏭McKinsey svela come l'AI generativa sta ridefinendo il panorama aziendale

🥶Direttiva NIS2: come gestire il processo di conformità

📐Exadata Exascale: l'architettura dati intelligente per il cloud di Oracle

🎧 Ma lo sai che anche Fjona ha la sua newsletter?! Iscriviti a SuggeriPODCAST!

📺 Trovi Fjona anche su RAI Play con Touch - Impronta digitale!

💌 Risolviamo i tuoi problemi di cuore con B1NARY

🎧 Ascolta il nostro imperdibile podcast Le vie del Tech

💸E trovi un po' di offerte interessanti su Telegram!