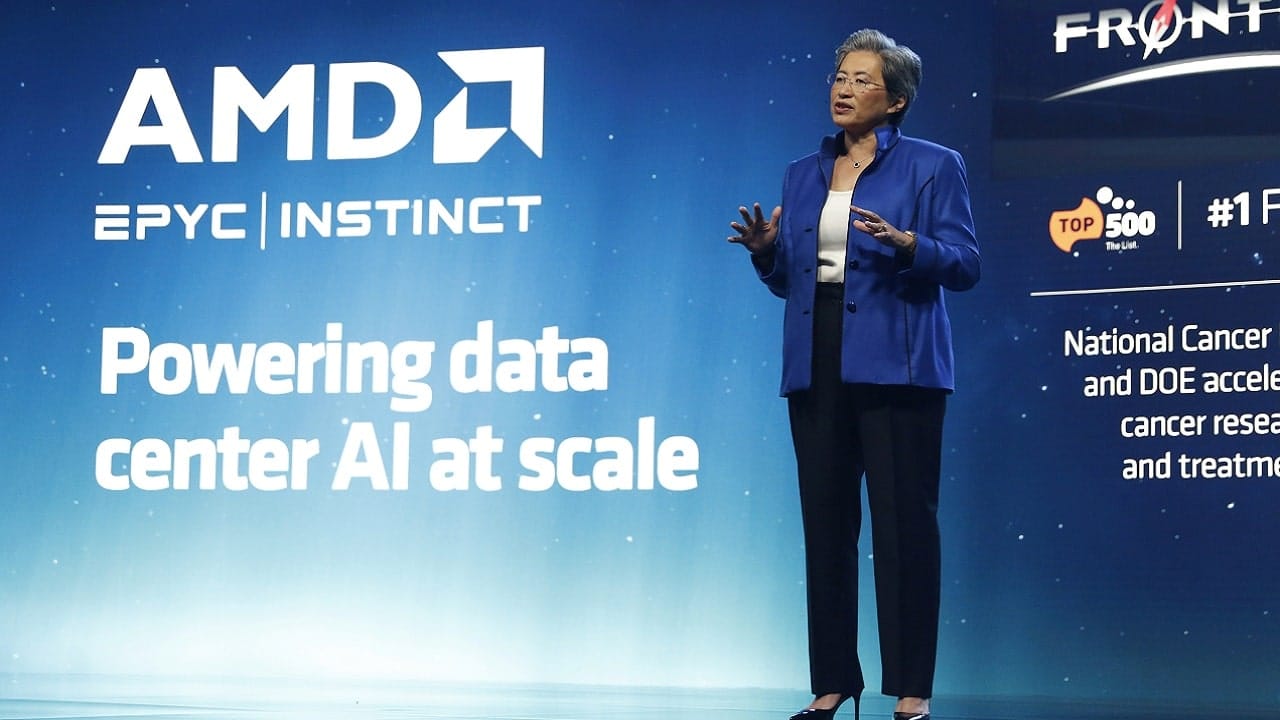

AMD ha presentato al “Data Center and AI Technology Premiere” la sua strategia per il futuro del computing, mostrando i prodotti, le soluzioni e i partner che contribuiranno a creare il data center e l’IA del domani. Con novità ce riguardano il contetto di Modern Data Center, l’AI pervasivo ma anche il futuro del Networking.

Data center e AI del futuro, tutte le novità annunciate da AMD

AMD ha arricchito il suo portafoglio di CPU ad alte prestazioni per soddisfare le diverse esigenze di cloud, general purpose e technical computing. Come le server CPU Amazon Elastic Compute Cloud (Amazon EC2) M7a instances, basate su CPU EPYC di quarta generazione. Ha introdotto il processore AMD EPYC 97X4 di quarta generazione (precedentemente noto come “Bergamo”) per il native cloud computing e annunciato il processore AMD EPYC di quarta generazione con tecnologia AMD 3D V-Cache (precedentemente denominato “Genoa-X”) per il technical computing.

Inoltre, AMD ha lanciato l’acceleratore AMD Instinct MI300X, l’acceleratore più avanzato al mondo per l’IA generativa, insieme allo sviluppo dell’ecosistema software con i partner PyTorch e Hugging Face. E ha evidenziato la prossima generazione della sua roadmap DPU, chiamata in codice “Giglio”, che mira a offrire ai clienti maggiori performance ed efficienza energetica rispetto ai prodotti della generazione attuale.

La dott.ssa Lisa Su, presidente e CEO di AMD, ha commentato: “Oggi, abbiamo compiuto un altro significativo passo avanti nella nostra strategia di data center espandendo la nostra famiglia di processori EPYC di quarta generazione con nuove soluzioni leader per i carichi di lavoro cloud e di elaborazione tecnica e annunciato nuove istanze pubbliche e distribuzioni interne con i maggiori fornitori di servizi cloud. L’intelligenza artificiale è la tecnologia che definisce la prossima generazione di computer e la più grande opportunità di crescita strategica per AMD. Siamo concentrati sull’accelerazione dell’implementazione delle piattaforme AI AMD su larga scala nel data center, guidati dal lancio dei nostri acceleratori Instinct MI300 pianificato per la fine di quest’anno e dal crescente ecosistema di software AI pronto per l’azienda ottimizzato per il nostro hardware”.

Acquista con i Sottocosto Mediaworld, scopri di più!

La quarta generazione di processori EPYC

AMD ha annunciato una serie di novità per la sua linea EPYC di quarta generazione, pensate per fornire ai clienti la specializzazione del carico di lavoro che serve per rispondere alle esigenze specifiche delle imprese.

AMD ha mostrato come il processore AMD EPYC di quarta generazione continui a offrire prestazioni e efficienza energetica di livello superiore. Ad AMD si è aggiunta AWS per dare un’anticipazione delle istanze M7a di Amazon Elastic Compute Cloud (Amazon EC2) di nuova generazione, basate su processori AMD EPYC di quarta generazione (“Genova”). Fuori dall’evento, Oracle ha comunicato l’intenzione di lanciare nuove istanze Oracle Computing Infrastructure (OCI) E5 con processori AMD EPYC di quarta generazione.

Inoltre, AMD ha presentato i processori AMD EPYC 97X4 di quarta generazione, precedentemente chiamati “Bergamo”. Con 128 core “Zen 4c” per socket, questi processori offrono la massima densità di vCPU e prestazioni di riferimento per le applicazioni che girano nel cloud e un’efficienza energetica leader. Ad AMD si è unito Meta che ha parlato di come questi processori siano adatti per le loro applicazioni principali come Instagram, WhatsApp e altro. Inoltre, ha discusso di come Meta stia ottenendo notevoli miglioramenti delle prestazioni con i processori AMD EPYC 97×4 di quarta generazione rispetto a AMD EPYC di terza generazione su vari carichi di lavoro, offrendo allo stesso tempo sostanziali miglioramenti del TCO e di come AMD e Meta abbiano ottimizzato le CPU EPYC per l’efficienza energetica e i requisiti di densità di calcolo di Meta.

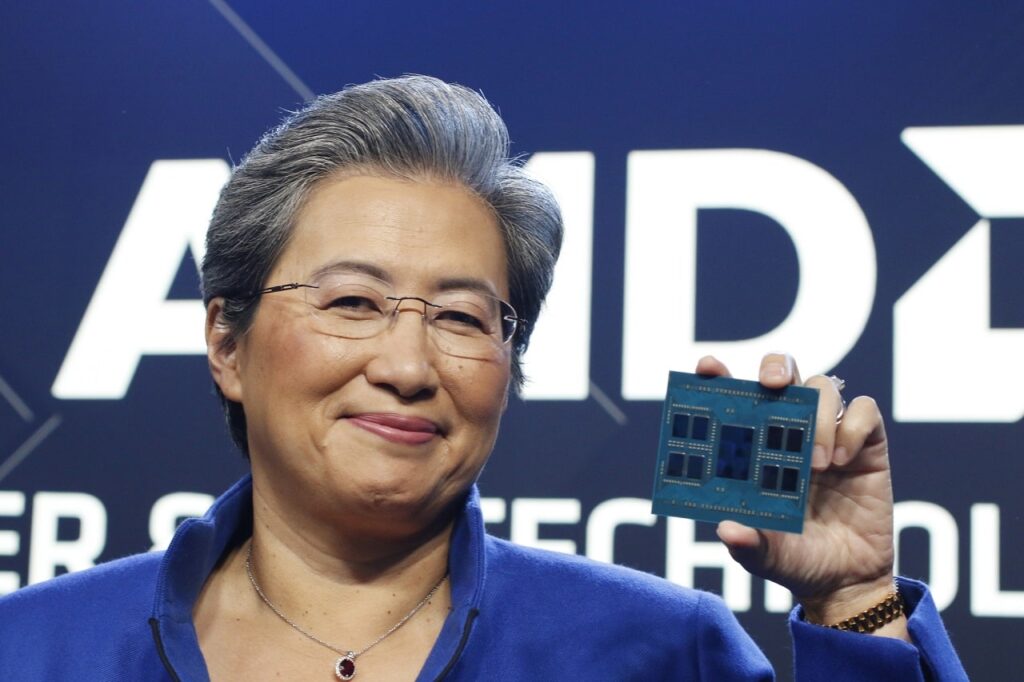

Abilitare prodotti migliori con il calcolo tecnico. AMD ha presentato i processori AMD EPYC di quarta generazione con tecnologia AMD 3D V-Cache, la CPU per server x86 con le prestazioni più elevate al mondo per il calcolo tecnico.

Le soluzioni per l’AI

AMD ha fatto oggi una serie di comunicazioni che illustrano la sua AI Platform strategy, che offre ai clienti un portafoglio di prodotti hardware cloud, to edge, to endpoint, con una forte collaborazione software di settore, per creare soluzioni AI scalabili e pervasive.

AMD ha condiviso nuovi dettagli della famiglia di acceleratori della serie AMD Instinct MI300, inclusa la presentazione dell’acceleratore AMD Instinct MI300X, l’acceleratore più avanzato al mondo per l’IA generativa. L’MI300X si basa sull’architettura dell’acceleratore AMD CDNA 3 di nuova generazione e supporta fino a 192 GB di memoria HBM3 per offrire l’efficienza di elaborazione e memoria necessaria per l’addestramento e l’inferenza di modelli di linguaggio di grandi dimensioni per carichi di lavoro di intelligenza artificiale generativa.

Con la vasta memoria di AMD Instinct MI300X, i clienti possono ora adattare modelli di linguaggio di grandi dimensioni come Falcon-40, un modello di parametri 40B su un singolo acceleratore MI300X5. AMD ha anche introdotto la piattaforma AMD Instinct, che combina otto acceleratori MI300X in un design standard del settore per la soluzione definitiva per l’inferenza e l’addestramento dell’IA.

AMD ha lanciato ROCm, un ecosistema software per gli acceleratori di data center per l’AI. PyTorch ha illustrato la collaborazione tra AMD e la PyTorch Foundation per integrare completamente lo stack software ROCm, offrendo supporto “giorno zero” per PyTorch 2.0 con ROCm versione 5.4.2. Hugging Face, la principale piattaforma aperta per i costruttori di intelligenza artificiale, ha annunciato che ottimizzerà migliaia di modelli Hugging Face su piattaforme AMD.

Acquista con i Sottocosto Mediaworld, scopri di più!

AMD fra data center moderni e AI: le novità per il networking

AMD ha mostrato una forte gamma di soluzioni di rete tra cui la DPU AMD Pensando, le NIC AMD Ultra Low Latency e le NIC Adaptive AMD. Queste offrono ai clienti una maggiore flessibilità, sicurezza e prestazioni per le loro infrastrutture cloud e aziendali.

Le DPU AMD Pensando integrano un potente software con la “sicurezza zero trust” e un processore di pacchetto programmabile all’avanguardia per creare la DPU più intelligente e veloce al mondo. La adottano già importanti partner cloud come IBM Cloud, Microsoft Azure e Oracle Cloud Infrastructure. Nel settore aziendale, è implementata nello Smart Switch HPE Aruba CX 10000 e con clienti come la società leader di servizi IT DXC e come parte di VMware vSphere Distributed Services Engine, migliorando le prestazioni delle applicazioni per i clienti.

AMD ha anche svelato la prossima generazione della sua roadmap DPU, chiamata “Giglio”, che punta a fornire ai clienti prestazioni ed efficienza energetica superiori, rispetto ai prodotti della generazione corrente, quando dovrebbe essere lanciata entro la fine del 2023.

L’azienda ha inoltre presentato il kit di sviluppo Software-in-Silicon (SSDK) di AMD Pensando, che consente ai clienti di sviluppare o trasferire rapidamente i servizi da eseguire sulla DPU programmabile AMD Pensando P4.

Trovate maggiori informazioni e il replay dell’evento sul sito AMD.

- Velocità di base: 3,8 GHz, velocità di alimentazione ottima: fino a 4,7 GHz

- Il processore da gioco d'élite

- Con AMD Ryzen per i creatori di contenuti

- Otto core della CPU

- Numero di thread: 16